本篇博客主要是针对这篇微信推文的笔记和一些想法,简单记录一下。这篇推文是SK海力士的一个深度相机传感器的广告,不过还是有一些可以学习的东西,当做科普看挺不错的。

0.前言

地球上最古老的生物大约出现在34亿年前。在此之后,生命的进化一直相对缓慢。直到大约5.4亿年前,生命的进化速度突然加快,这一时期又被称为寒武纪生命大爆发。导致这一变化的原因之一就是生物感官的进化。在此过程中,眼睛的出现是最重要的一部分(莫名想到岩王爷的创龙点睛,原神后遗症,哈哈)。大脑的一部分凸出成为眼睛,开始观察这个世界。这致使生物体增加了对能量的需求,并且因为各种新信息扩大了适应和运动的范围。可以说,视觉,对于生物而言,具有极其重要的地位。在电子设备上,摄像头扮演着类似的角色——摄像头上的CMOS图像传感器(CMOS Image Sensor, CIS)具有像人眼视网膜一样捕捉图像的功能。

1.模拟人眼

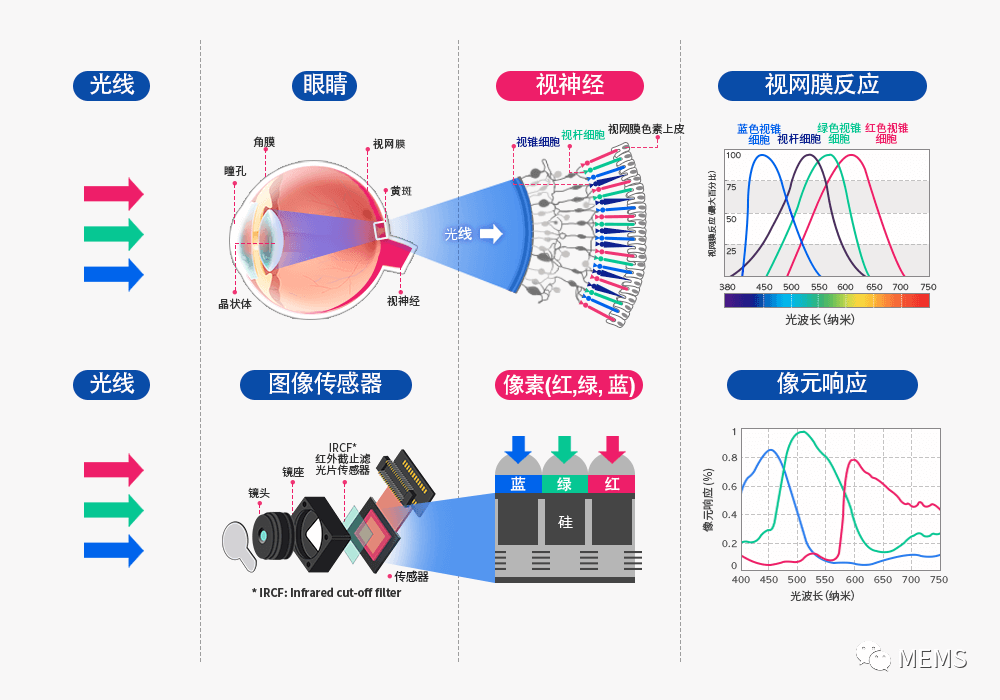

CIS最大的作用就是准确再现我们所观察到的世界。我们希望它和人眼具有相似的分辨率,可以清楚分辨各种明暗环境以及识别高速移动的物体。下图为CIS的基本像素(Pixel)的结构和成像操作特性。

可以直观的看到,物体反射的光线通过光学系统进入光电二极管,当光线中的光子能量超过半导体带隙的能量时,就会产生电子-空穴对(e-/h+)。根据光的强度,累积和读取该信号即可形成2D图像。硅元素的带隙能量为1.1eV(电子伏特),可以覆盖整个人眼可见的光谱范围。当然你可能会说,光不是一种电磁波吗?没错,这就是所谓的光的波粒二象性。听起来一个很高大上的概念没想到会在我们每天都在使用的摄像头上应用。

可以直观的看到,物体反射的光线通过光学系统进入光电二极管,当光线中的光子能量超过半导体带隙的能量时,就会产生电子-空穴对(e-/h+)。根据光的强度,累积和读取该信号即可形成2D图像。硅元素的带隙能量为1.1eV(电子伏特),可以覆盖整个人眼可见的光谱范围。当然你可能会说,光不是一种电磁波吗?没错,这就是所谓的光的波粒二象性。听起来一个很高大上的概念没想到会在我们每天都在使用的摄像头上应用。

2.各种场景下的感知

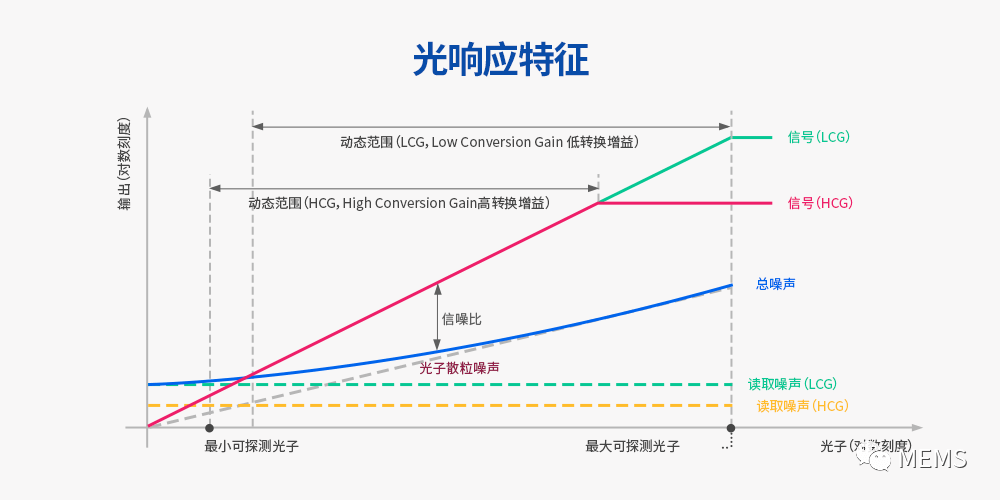

要想图像在黑暗情况下清晰可见,需要放大来自微弱光线的信号,同时尽可能抑制非光信号(噪点)。相反的,如果在明亮环境下,则需要接收大量的强光并加以区分。这些特征可以使用所谓的SNR(信噪比)和DR(动态范围:满阱容量噪声比)来量化。

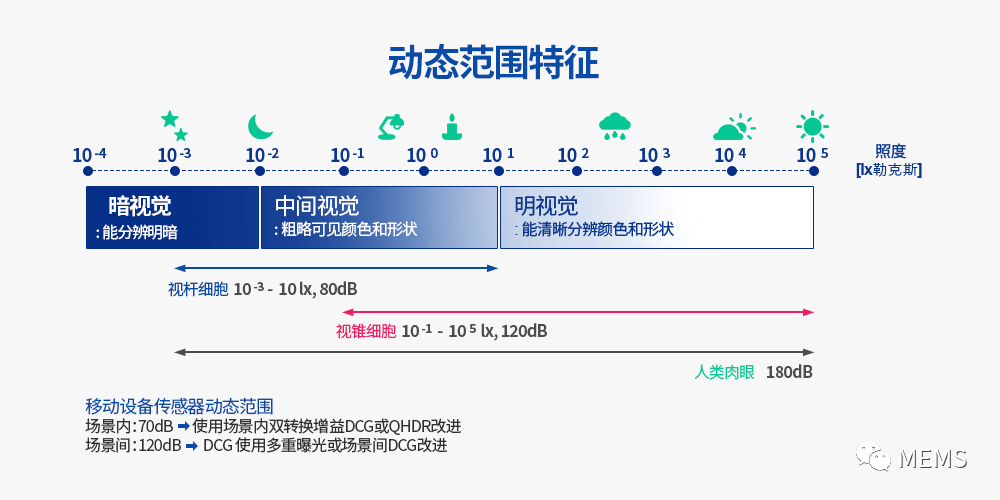

目前摄像头可以在5勒克斯(lux)的环境下进行视觉感知。在动态范围方面,人眼的场景内和场景间动态范围通常分别为120dB和180dB,目前智能手机的场景内和场景间动态范围分别为70dB和120dB,如下图所示。

对于这种情况,目前电子摄像头普遍采用的解决方案是HDR来进行多帧合成,从而获得更大的动态范围。

对于这种情况,目前电子摄像头普遍采用的解决方案是HDR来进行多帧合成,从而获得更大的动态范围。

影响上述特性的最重要因素就是像素的尺寸和分辨率。为了获得更高的分辨率,在CMOS面积不变的情况下,必须缩小单个像素尺寸(像元大小)。在缩小像素尺寸的情况下保持单个像元的特性不变是关键因素。

3.像素尺寸与分辨率

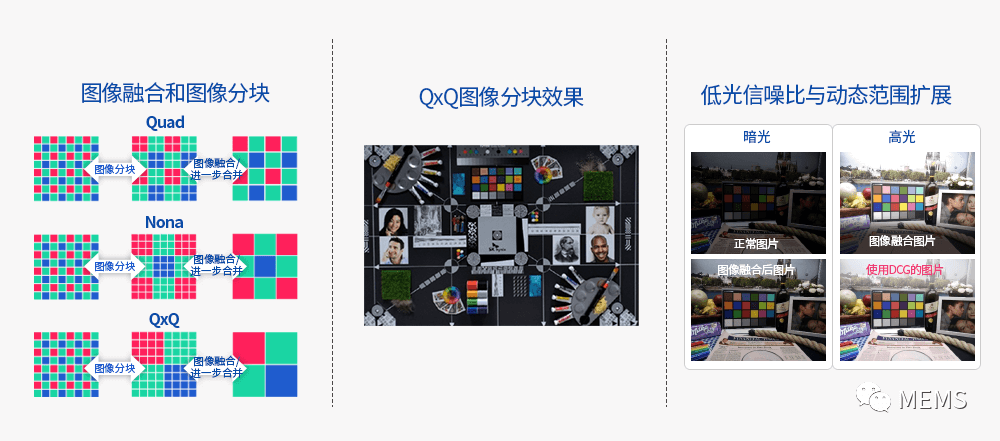

人眼对静止图像中心部分的分辨率约为5.76亿像素,对移动图像的分辨率约为800万像素。CIS一直不断进步以赶上人眼的水平。在将像素尺寸降至1.12μm并将分辨率提升至1300万像素以后,CIS技术的研发速度开始变得缓慢。但是Quad技术(使用相同的滤光片合并2×2像素)的引入再一次加快了像素尺寸缩小的发展速度。最近,这一水平已达到了0.7μm范围,分辨率也提升至6400万像素。不仅如此,随着NONA(3×3)和QxQ(4×4)技术的发展,像素尺寸已达到0.6x μm的范围。反过来,像素尺寸缩小技术催生除了近期提出的1.08亿像素分辨率的图像传感器。下图简单展示了这些技术的原理。

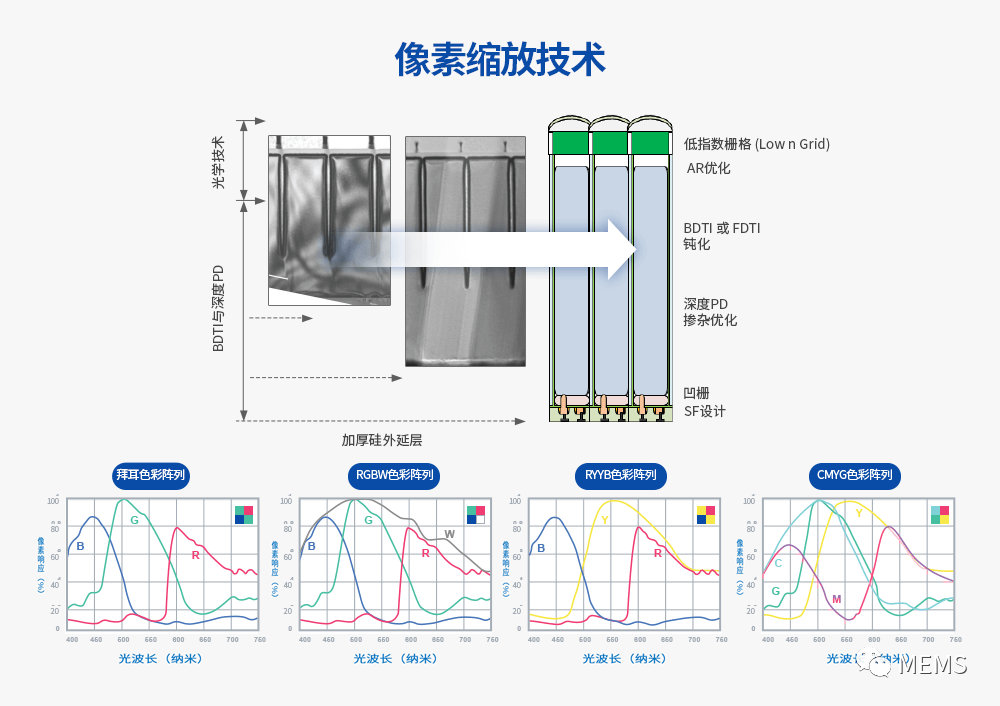

缩小图像传感器体积(包括缩小像素尺寸)是所有半导体公司共同面对的挑战。为了在更小的尺寸上保持相同的功能特性,这些公司在设备和制造工艺上进行了大量的技术开发工作。此类技术包括:掺杂优化(doping optimization)和垂直转移栅(vertical transfer gate)——以提高全阱容量(FWC),同时保持电荷转移效率;源跟踪工程(source follower engineering)和各种降噪技术;滤色器隔离(color filter isolation)和深沟槽隔离(deep trench isolation)技术——将相邻像素之间的干扰降至最低;使用较厚的外延层(epi layer)来提高像素感光度或应用各种滤色器相关技术等。

缩小图像传感器体积(包括缩小像素尺寸)是所有半导体公司共同面对的挑战。为了在更小的尺寸上保持相同的功能特性,这些公司在设备和制造工艺上进行了大量的技术开发工作。此类技术包括:掺杂优化(doping optimization)和垂直转移栅(vertical transfer gate)——以提高全阱容量(FWC),同时保持电荷转移效率;源跟踪工程(source follower engineering)和各种降噪技术;滤色器隔离(color filter isolation)和深沟槽隔离(deep trench isolation)技术——将相邻像素之间的干扰降至最低;使用较厚的外延层(epi layer)来提高像素感光度或应用各种滤色器相关技术等。

如今的半导体通过上述的技术实现了与经过数百万年进化而来的生物的眼睛几乎相同的性能。然而在功效方面仍有改进的可能。

如今的半导体通过上述的技术实现了与经过数百万年进化而来的生物的眼睛几乎相同的性能。然而在功效方面仍有改进的可能。

4.超越人眼

在CIS的应用领域扩大过程中,最具代表性的就是深度传感技术。早期我们利用两台摄像机模仿人眼的双眼视差来感知距离。然而,人们还需要努力突破精确度、距离可扩展性及两台摄像机之间最小距离(基线)等方面的限制。这也就是我们很常见的双目的相机配置,可以看做是一种被动的、纯视觉的解决方案。

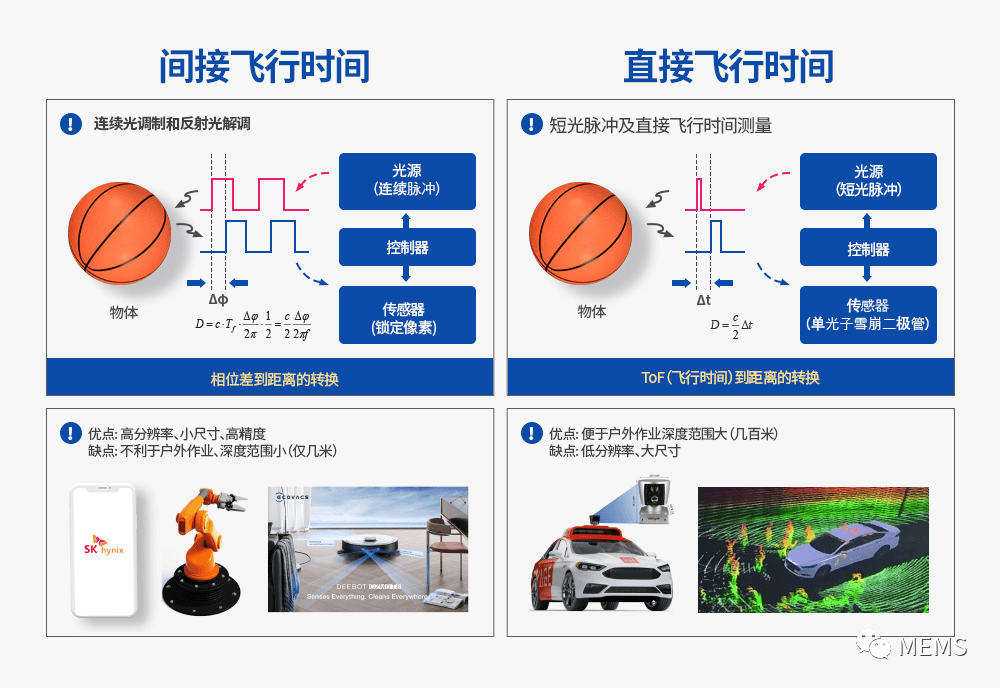

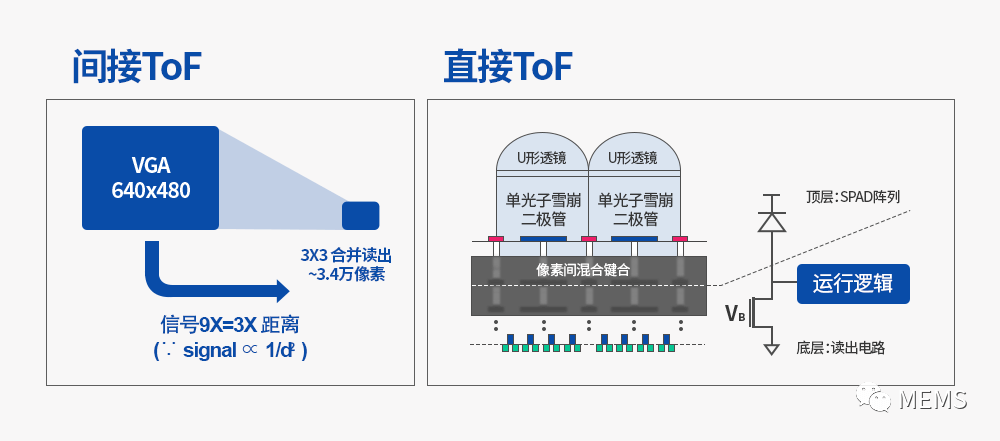

后来人们尝试使用主动式解决方案。一个直接的想法是根据光线从物体反射后返回的时间差来测量距离。这类方法被称为“飞行时间”(ToF)法,它进一步又分为两种类型,即直接飞行时间(dToF)和间接飞行时间(iToF)。间接飞行时间的传感基于模拟电荷累积的工作原理,由于信号在远距离衰减,其可测量距离范围受到局限。而直接飞行时间在分辨率上有局限性,由于检测每一个单光子(SPAD:单光子雪崩二极管)单元大小非常棘手,再加上还需要在每个单元中堆叠以读出电路。

上图展示了dToF和iToF的原理。简单来说,直接飞行时间法实现的是时间到距离的转换,而间接飞行时间法实现的是相位差到距离的转换。直接飞行时间法的优势在于便于户外作业且深度范围大(几百米),缺点是低分辨率和大尺寸;而间接飞行时间法的优势在于高分辨率、小尺寸、高精度,其缺点是不利于户外作业,深度范围小(仅几米)。

上图展示了dToF和iToF的原理。简单来说,直接飞行时间法实现的是时间到距离的转换,而间接飞行时间法实现的是相位差到距离的转换。直接飞行时间法的优势在于便于户外作业且深度范围大(几百米),缺点是低分辨率和大尺寸;而间接飞行时间法的优势在于高分辨率、小尺寸、高精度,其缺点是不利于户外作业,深度范围小(仅几米)。

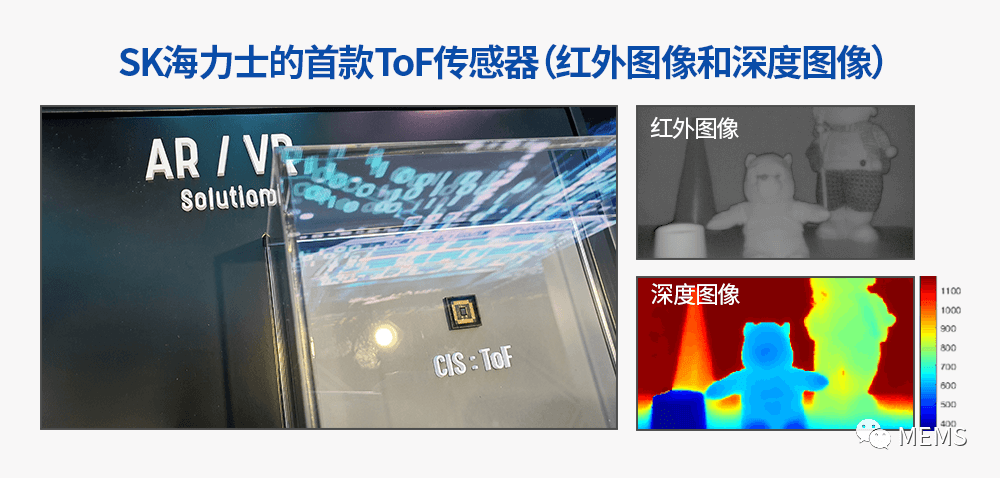

如下是SK海力士推出的ToF传感器,可以看到,可以同时输出红外和深度的图像。

事实上,iPhone和iPad中号称的LiDAR其实并不是和Velodyne机械式或者Livox式的固态激光雷达,而是ToF相机。或者说类似于Realsense D435i的模式。

事实上,iPhone和iPad中号称的LiDAR其实并不是和Velodyne机械式或者Livox式的固态激光雷达,而是ToF相机。或者说类似于Realsense D435i的模式。

5.小结

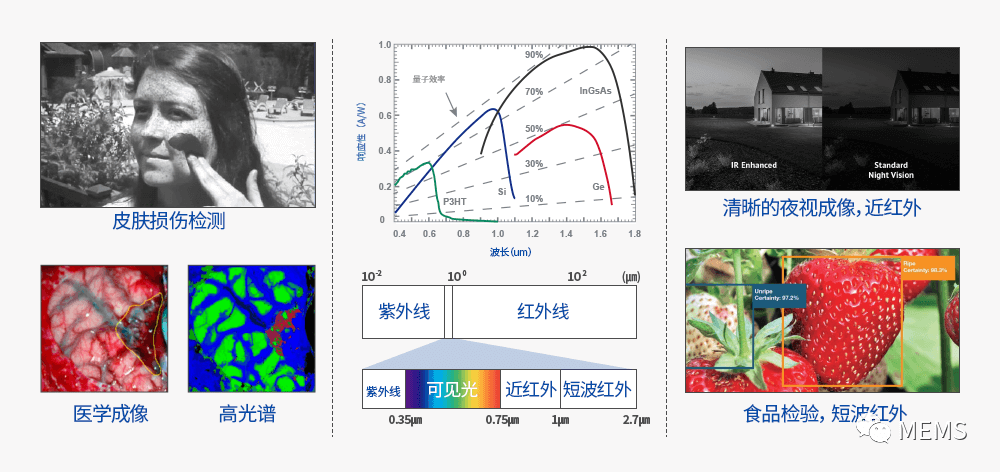

CIS以广谱光为基础,利用可见光、紫外光、近红外光、短波红外光等,扩大应用领域,为丰富人类生活做出贡献。此外,多光谱和高光谱成像,或偏振传感器也开始发挥助力作用。

6.参考资料

- [1] https://mp.weixin.qq.com/s/NXdapGH1zWrDa4X0uNO71Q

本文作者原创,未经许可不得转载,谢谢配合